La révolution de l’Intelligence Artificielle : quels impacts sur le travail ?

L’Intelligence Artificielle (IA) est de plus en plus présente dans notre quotidien : reconnaissance vocale sur nos smartphones, objets connectés, traductions automatiques, recherches internet etc. Mais quel impact a concrètement l’IA sur le monde du travail ? Pour les employeurs comme pour les salariés, elle offre des opportunités évidentes (cybersécurité, robots dans les usines, climatisation intelligente, etc.) mais elle génère également des limites et des risques.

Plus d’informations dans notre article focus.

NB : cet article a été rédigé en mars 2025 et tend à évoluer en même temps que l’IA se perfectionne et fait naître de nouveaux enjeux.

Pour commencer, c’est quoi exactement l’Intelligence Artificielle (IA) ?

L’IA est…

Selon le Parlement européen, l’IA représente tout outil utilisé par une machine afin de « reproduire des comportements liés aux humains, tels que le raisonnement, la planification et la créativité« . Pour la CNIL, la définition pourrait s’élargir également aux comportements dépassant les capacités humaines. Ainsi, elle qualifierait l’IA comme « tout système mettant en œuvre des mécanismes proches de celui d’un raisonnement humain« .

Si on demande à ChatGPT de définir l’IA, il répond alors qu’elle désigne « la capacité d’une machine ou d’un système informatique à accomplir des tâches qui nécessitent généralement l’intelligence humaine, comme la compréhension du langage, la reconnaissance d’images, la prise de décisions ou l’apprentissage à partir d’expériences« . L’IA peut être divisée en deux catégories principales : l’IA dite « faible », conçue pour des tâches spécifiques, et l’IA forte, qui vise à reproduire une intelligence humaine générale.

L’IA n’est pas…

L’Intelligence Artificielle n’est ni dotée de conscience ou d’émotion, ni de volonté propre.

En effet, la complexité du fonctionnement cérébral humain est telle que l’IA en reste éloignée. Elle se base sur des études de probabilité et donnera donc une réponse en fonction de cela. Il y a donc un enjeu capital à définir et expliquer clairement nos objectifs mais aussi adapter la quantité de tâches lors de nos requêtes. Également, il faut garder à l’esprit que dès lors que toutes les données ne sont pas accessible à une IA, les réponses peuvent ne pas refléter la réalité.

Enfin, retenons que l’Intelligence Artificielle est en fait une traduction incomplète de l’anglais Artificial Intelligence, en cela que la signification du mot anglais « intelligence » renvoie aussi à la notion d’information, ou de renseignement (c’est le cas aussi pour CIA – Central Intelligence Agency ou l’agence centrale du renseignement).

L’expression « Artificial Intelligence », peut donc s’appliquer plus à une collecte et exploitation de données, qu’à une faculté de comprendre et d’intuiter des phénomènes.

L’IA au travail : quels impacts ?

L’intelligence artificielle ne se contente pas d’automatiser des tâches spécifiques. Elle cherche à reproduire et automatiser certaines fonctions cognitives humaines, comme la perception et la prise de décision. Cela soulève d’autant plus de questions sur son impact potentiel sur l’emploi.

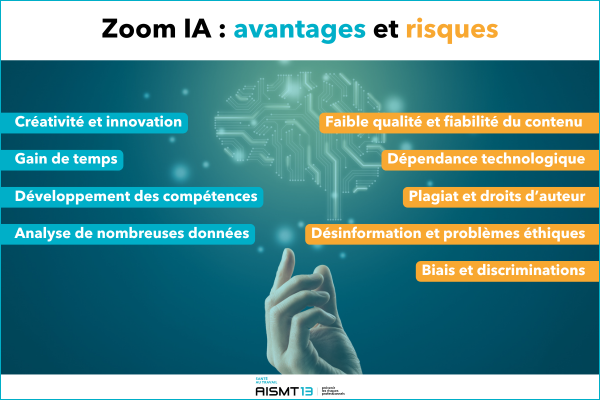

Les avantages de l’IA au travail

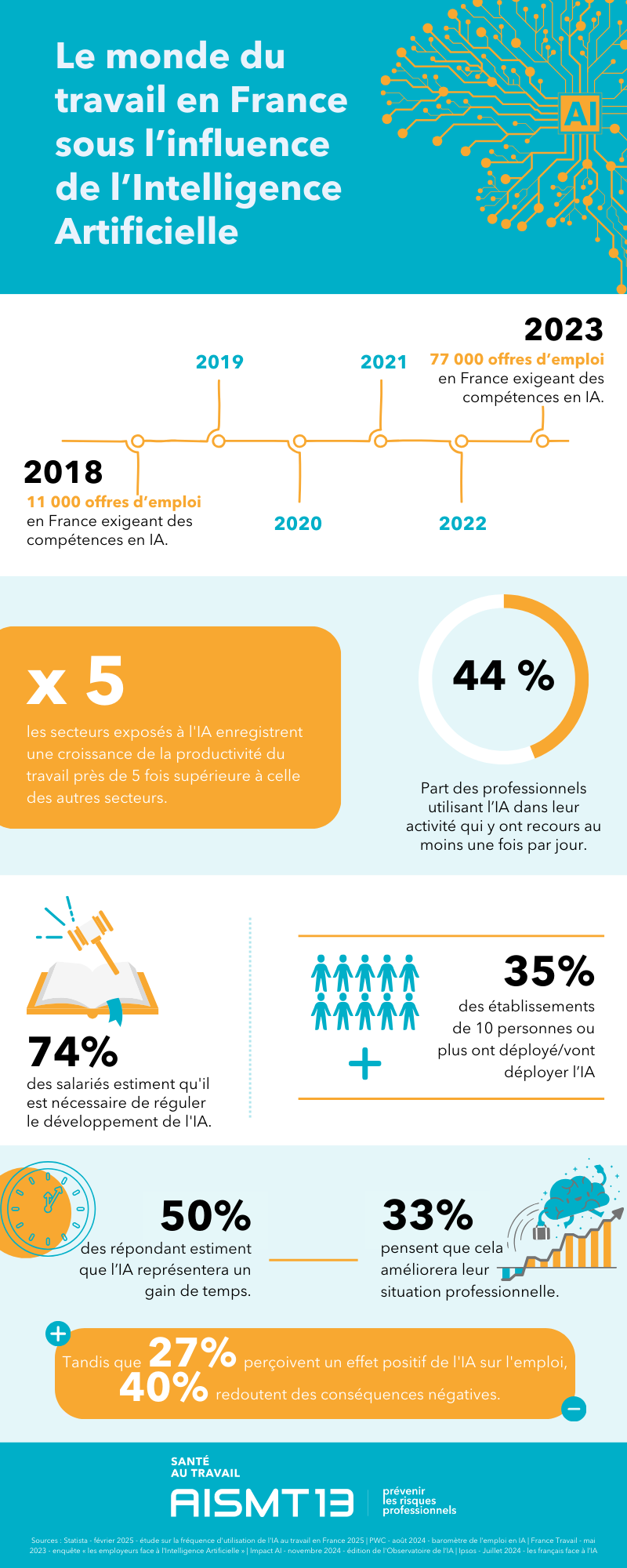

Entre 11% et 37% : estimation de l’augmentation de la productivité du travail liée à l’IA d’ici 2035 (Source : EP Think Tank 2020).

En effet, quelques avantages sont tout à fait impactants :

- Améliorer la maintenance des machines et améliorer le rendement par l’automatisation des tâches répétitives : cela pourrait permettre de redonner un sens au travail, de donner plus d’autonomie et de préserver la santé physique.

- Réduire les délais de traitement au niveau des services clients et des centres d’appels : gain d’efficacité et de réactivité.

- Créer de nouvelles voies de vente et de services pour les consommateurs : personnalisation des recommandations après analyse des préférences individuelles des clients.

- Optimiser la qualité et la précision des diagnostics dans l’industrie ou la médecine pour minimiser les erreurs humaines.

- Réduire les coûts dans tous les domaines d’activité.

- Étendre les plages de disponibilité 7J/7 et 24h/24.

- Assister la créativité et développer de nouveaux potentiels.

Les risques de l’IA au travail

1/ En lien avec son fonctionnement :

- Limite de fiabilité : en se basant sur des corrélations statistiques plutôt que sur une compréhension de la réalité, certaines réactions pourraient ne pas prendre en compte les changements réels et devenir inappropriées.

- Limite des probabilités : les réponses de l’IA sont plausibles, mais pas nécessairement correctes.

- Limite de communication : traduire la complexité et la nuance d’objectifs humains en langage informatique = risque de méprise des instructions

- Limite des ressources humaines

2/ Un impact sur l’environnement : le coût énergétique est très élevé tant en électricité (consommation des data centers d’ici 2030 : 13% de la consommation d’électricité mondiale contre 3% actuellement, liée à une demande énergétique en croissance de 35% par an actuellement) qu’en besoin en eau (celle consommée sur place et celle nécessaire à la production d’électricité en surplus éventuellement).

3/ Des enjeux sociétaux souvent associés aux mésusages de l’IA. Ils intègrent : les risques liés à la perte d’emplois massive, les menaces pour le respect de la vie privée, la dépendance technologique, les problémes liées aux responsabilités et à l’éthique, les usages malveillants (détournement d’informations, fausses informations etc.), les risques psychosociaux, le détournement d’outils dédiés à la surveillance (à des fins de management digital par exemple), etc.

4/ Des dangers psychiques, notamment des risques de dégradation des fonctions cognitives supérieures, induits par exemple par le manque d’implication active et de sollicitation de tous nos sens, par l’anxiété, les distractions multiples, le manque d’émotions positives, etc.

Il y aussi des risques de dégradation des fonctions exécutives dès lors que notre capacité à résister aux tentations ou à rester concentré sur une seule tâche n’est plus optimale. Il en va de même pour notre capacité à raisonner ou à mémoriser, à faire preuve de pensées divergentes, à prendre de la distance avec l’information, etc.

Des stratégies de prévention définies en tenant compte des défis de l’IA et des difficultés : les conseils de nos experts de l’AISMT13

Mettre en place la prévention collective

- Évaluation des risques : identifier les domaines de l’entreprise où l’IA est utilisée ou pourrait être utilisée.

- Transparence et responsabilité : les systèmes d’IA doivent être transparents et compréhensibles. Les décisions prises par l’IA doivent être explicables.

- Supervision indépendante : maintenir un niveau de contrôle humain approprié sur les systèmes d’IA. Les humains doivent pouvoir intervenir en cas de besoin pour corriger les décisions automatisées.

- Dialogue social : concertation des salariés, implication des instances représentatives et évaluation des impacts de l’implantation d’outils digitaux sur les conditions de travail.

- Formation et sensibilisation : compréhension des avantages et limites de l’IA, sensibilisation des travailleurs aux risques potentiels liés et encourager un dialogue ouvert sur ces questions pour accompagner le changement.

- Audit et surveillance : repérer et corriger les biais de systèmes, les erreurs et les comportements indésirables, et cela en permanence pour détecter tout signe de défaillance ou de comportement inattendu.

- Développement éthique : tenir compte des conséquences sociales et éthiques de ses applications.

- Législation et régulation : respecter les lois et les réglementations locales et internationales en matière d’IA, et participer activement aux discussions sur la régulation de l’IA.

- Partage de connaissances : collaborer avec d’autres entreprises et experts de l’IA pour partager des bonnes pratiques, des leçons apprises et des solutions aux problèmes communs.

- Flexibilité et adaptabilité : ajuster les stratégies et processus en fonction de l’évolution rapide de la technologie et des meilleures pratiques en matière d’IA.

En plus si nécessaire : consultation externe en éthique de l’IA, en cybersécurité et en protection de la vie privée pour évaluer et améliorer los pratiques.

Sans oublier la prévention individuelle !

Au delà des stratégies mises en place en entreprise, il est fondamental de rester vigilant, à titre individuel, quant à la nature des données collectées et leur usage (paramètres de confidentialité des applications, régulation des cookies, etc.). Ainsi, le choix de ses outils de navigation peut être fait en fonction de la collecte que l’on souhaite autoriser ou non mais quoi qu’il en soit, restons toujours conscient des risques !

Et demain, la prévention des risques professionnels avec l’IA pourrait être améliorée

L’IA pourrait jouer un rôle majeur dans le bien-être au travail à l’avenir : anticipation du stress, réorganisation des charges de travail excessives, amélioration de la qualité de vie au travail. Une piste d’exploration pour les entreprises soucieuses du bien-être de leurs collaborateurs !

Plus largement, différentes applications peuvent être envisagées : une meilleure prédiction des accidents potentiels pour mieux les éviter, des dispositifs spécifiques basés sur les paramètres environnementaux (qualité de l’air, bruit, température, etc.) pour alerter au plus tôt en cas de conditions de travail dangereuses, optimisation de l’ergonomie des postes de travail (en lien avec le déploiement des exosquelettes notamment), et alerter en cas de conditions dangereuses.

Attention à toujours garder en tête les risques potentiels pour adapter ses usages !

Quelle réglementation en matière d’IA ?

Le Parlement européen a fixé ses priorités en matière d’IA. 5 objectifs : sûr, transparent, traçable, non discriminatoire et respectueux de l’environnement.

Ainsi, le 21 mai 2024, le Conseil Européen a adopté la première loi sur l’IA dans le monde. Elle entrera en vigueur par paliers jusqu’en 2026 (2027 pour les systèmes à haut risque).

Ce qu’il faut en retenir :

-

Définition de différents niveaux de risque : « minimal », « élevé » (avec un impact négatif sur la sécurité ou les droits fondamentaux), « inacceptable » (menace pour les personnes)

-

Exigences de transparence : l’IA générative, comme ChatGPT, ne sera pas classée à haut risque, mais devra se conformer à ces exigences et à la loi. Notamment, les contenus générés ou modifiés à l’aide de l’IA – images, fichiers audio ou vidéo (par exemple, les « deepfakes ») – doivent être clairement étiquetés comme étant générés par l’IA, afin que les utilisateurs sachent qu’il s’agit de ce type de contenu.

Pour en savoir plus, rendez-vous sur le site officiel.

Pour aller plus loin :

- Intelligence Artificielle (IA) : enjeux et impacts sur la santé au travail | Replay webinaire Présanse Paca-Corse